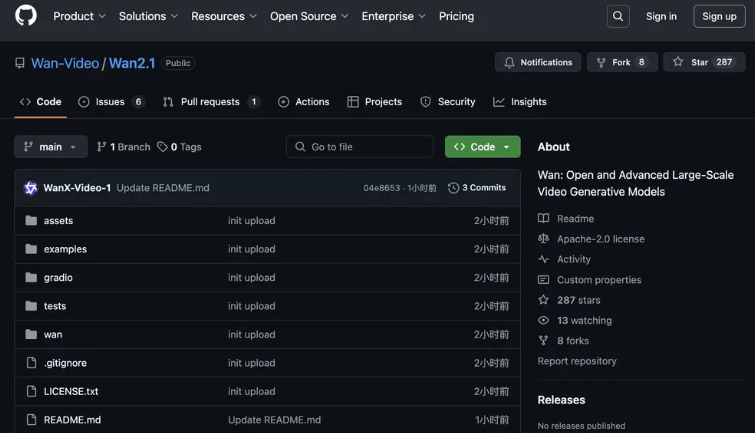

據報道,阿里(BABA.US)生成基座模型萬相2.1(Wan)宣布開源,在評測集中,超越 Sora、Luma等模型,位列榜首。

開源最強視頻大模型亮相

獲悉,萬相2.1共有兩個參數規模,140億參數模型適用于對生成效果要求更高的專業人士,13億參數模型生成速度較快且能兼容所有消費級GPU,兩個模型的全部推理代碼和權重已全部開源。

在視頻生成方面,萬相2.1通過自研的高效VAE和DiT架構增強了時空上下文建模能力,支持無限長1080P視頻的高效編解碼,首次實現了中文文字視頻生成功能,同時支持文生視頻、圖生視頻、視頻編輯、文生圖和視頻生音頻等多項任務。

據此前介紹,萬相2.1支持中英文視頻,可以一鍵生成藝術字,還提供多種視頻特效選項,以增強視覺表現力,例如過渡、粒子效果、模擬等。

分析人士稱,隨著萬相2.1模型開源,標志著阿里云實現了全模態、全尺寸的開源。這意味著更多的開發者,將能夠低成本獲取并使用該模型底層代碼,進而用以開展與自身業務相關的各類視頻生成應用。

開啟全模態開源新時代

自2025年以來,開源趨勢逐漸成為全球大模型領域的標配。國內方面,進入2月,多家企業紛紛推出了各自的開源模型,包括字節跳動的豆包以及百度的文心一言等,共同掀起了新一輪的開源熱潮。

國際方面,隨著萬相2.1完全開源,OpenAI、谷歌等競品也將直面商業化的挑戰:更好的模型已經開源了,AI生成視頻的定價也將面臨挑戰。谷歌Veo 2模型近期披露定價,每生成1秒視頻需要付費0.5美元,相當于生成一個小時的視頻需要花費1800美元。

微美全息開源多模態應用場景拓展

公開資料顯示,微美全息(WIMI.US)在AI視頻生成領域有顯著布局,涵蓋大語言、多模態等領域,面對開源視頻生成大模型賽道,從大語言模型到視覺生成模型,從基礎模型到多樣化的衍生模型,實現了全模態、全尺寸的開源,微美全息AI開源生態的發展正不斷被注入強大的動力。

事實上,近些年來,微美全息專注于多模態AIGC(生成式AI)研發,技術核心在于結合大規模預訓練與多模態算法優化,提升生成內容的連貫性和物理合理性。同時在行業生態上,微美全息已逐步實現文本生成視頻、圖像生成視頻等能力,支持劇情創作、短視頻生成等場景,未來可能通過API或行業解決方案,加速AI快速生成視頻能力技術迭代。

結語

未來,AI模型將進入一個分水嶺,機構普遍認為,阿里此舉將加速AI視頻技術商業化落地,并推動算力、云計算、內容創作等全產業鏈升級。所以說,AI下半場,不是簡單的技術競賽,而是一場關于資源、效率和成本的綜合博弈,這一新的革命正在加速中。

轉自:中國網

【版權及免責聲明】凡本網所屬版權作品,轉載時須獲得授權并注明來源“中國產業經濟信息網”,違者本網將保留追究其相關法律責任的權力。凡轉載文章及企業宣傳資訊,僅代表作者個人觀點,不代表本網觀點和立場。版權事宜請聯系:010-65363056。

延伸閱讀